Intimidade Sintética

Do afeto simulado à solidão hiperconectada

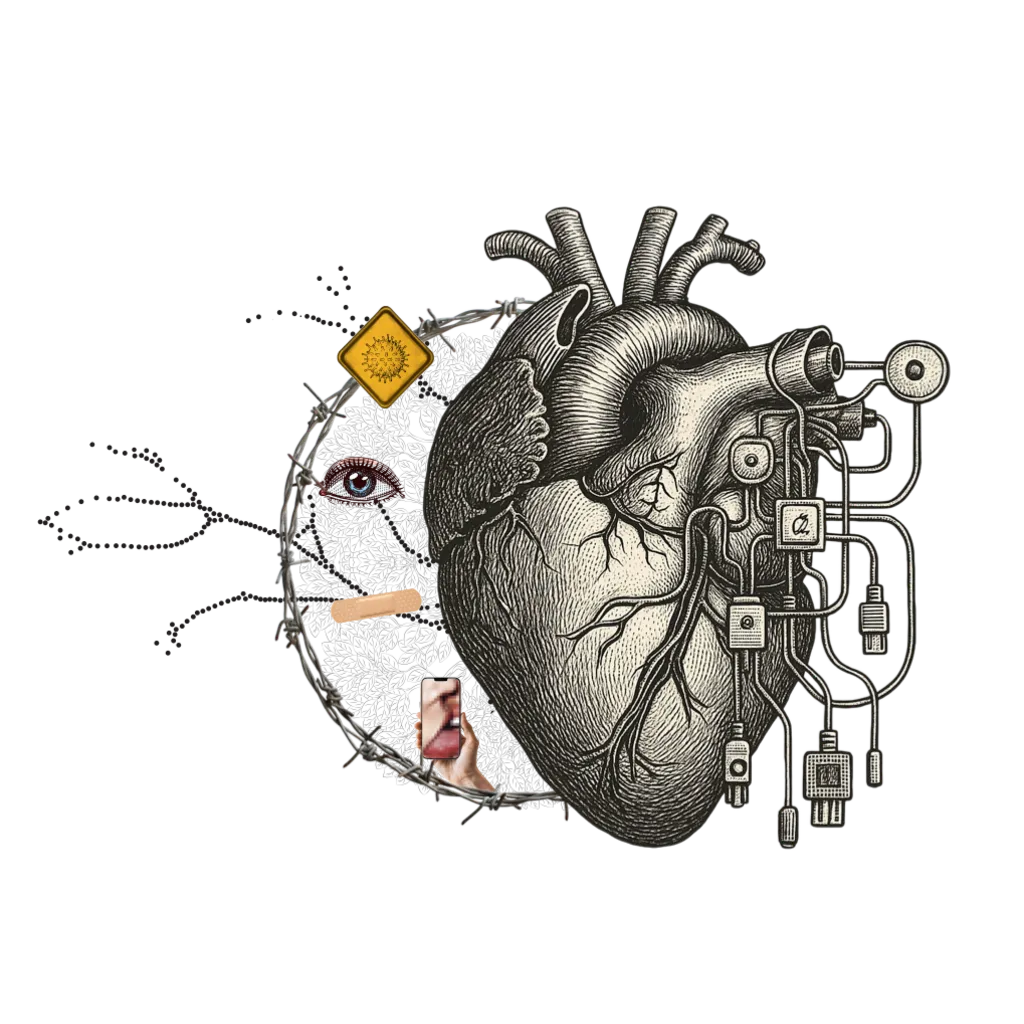

A tecnologia invadiu o campo do afeto. Companheiros artificiais prometem cuidado e presença, mas oferecem apenas o reflexo de nós mesmos. Entre a carência e o código, nasce a intimidade sintética, uma linguagem e vínculos que parecem humanos e empáticos, mas são laços emocionais delegados a máquinas. Essa simulação cria uma sensação ilusória, mas muito real, de uma relação verdadeira, que, para muitas pessoas, pode se tornar a mais importante de suas vidas.

O que dizem os dados

Há uma rápida e profunda penetração da “intimidade sintética” na vida cotidiana, indo muito além do uso meramente instrumental da tecnologia. Os dados da Talk Inc (2025), revelam que a IA está assumindo papéis emocionais e sociais significativos, transformando a maneira como compreendemos amizade, amor e companhia. Para muitos usuários, a IA deixou de ser ferramenta e passou a ser espelho, um “outro” digital que responde, acolhe e reflete emoções humanas.

Aproximadamente 58% dos brasileiros já recorreram à IA com o objetivo de usá-la como amigo ou conselheiro. Eles buscam um espaço seguro para expressar emoções, receber suporte ou obter perspectivas sobre problemas pessoais. A natureza não julgadora e a disponibilidade 24 horas por dia da IA tornam-na uma alternativa atraente para a socialização e o aconselhamento.

Além disso, o vínculo torna-secada vez mais afetivo e íntimo:

- Quase metade (46%) declara ter trocado ou conhecer alguém que troca mensagens afetivas com IAs. Isso engloba desde simples demonstrações de carinho até conversas mais profundas sobre sentimentos e intimidade emocional. A IA está sendo usada como um espelho para a expressão e exploração da afetividade.

- No espectro da sexualidade, 23% dos brasileiros já se engajaram ou estão prestes a se engajar na troca de mensagens sexuais com a IA (8% diretamente, 17% por meio de pessoas próximas).

- 28% dos entrevistados acreditam que o casamento com a IA será uma realidade no futuro.

- Os dados apontam que a IA não é vista apenas como uma ferramenta, mas como a antropomorfização de um ser social e emocionalmente relevante, desafiando as noções estabelecidas de amizade, amor e relações.

(Fonte: Talk.Inc — “IA na Vida Real”, 2025)

Dimensões do Impacto

Antropomorfismo e a solidão a longo prazo

Temos a tendência ancestral de antropomorfizar, projetar emoções humanas em tudo o que nos responde. Essa propensão, amplificada por sistemas de IA com voz suave e memória de conversas, cria uma simulação de companhia. Não é a máquina que sente; somos nós que sentimos através dela. Ao chamar de “amigo” um chatbot, deslocamos o sentido de vínculo.

A inteligência artificial está sendo usada como terapeuta por muitas pessoas, as pessoas acreditando que a máquina as ouve, fazendo terapia, confidenciando segredos […] isso começa a antropomorfizar o sistema e achar que tem um ser humano por trás.

Pesquisas (De Freitas et al., 2023) mostram que a falta de emoção é uma das 5 barreiras psicológicas que fazem com que as pessoas não confiem em sistemas de IA. Ou seja, que não proporciona a experiência emocional que demanda empatia e julgamento moral

O “black mirror” e o desaprendizado relacional

O conceito “black mirror” sintetiza essa captura da identidade por projeções algorítmicas. A orientação final é reabrir espaço para alteridade, reflexão e autoconsciência, restaurando agência para além da métrica e da recomendação. Como resume Sherry Turkle em Reclaiming Conversation: “sem conflito, sem pausa, sem silêncio — sem crescimento.”

Ao delegar escuta e cuidado à IA, deixamos de exercitar empatia, frustração e negociação — músculos sociais que se atrofiam com a conveniência digital. Ambientes sociossintéticos simulam empatia e companhia, naturalizando sentir, lembrar e decidir como funções delegadas a agentes não recíprocos. A performatividade mediada pela tecnologia reduz vulnerabilidade e confiança, favorecendo identidades moduladas para o olhar do algoritmo; crianças e adolescentes exigem prudência e proteção reforçada.

IAs conversacionais (como chatbots ou companheiros virtuais) podem funcionar como “echo chambers” ou câmaras de eco. Espelham o tom, valores e opiniões de quem interage com elas. Quando são treinadas para “concordar” ou demonstrar empatia, acabam reforçando a sensação de estar certo, compreendido ou validado, mesmo quando as crenças são extremas ou falsas.

A confiança excessiva na IA como substituto da sociabilidade humana cria um ciclo perigoso. Em casos extremos, esse deslocamento da realidade emocional tem levado a agravamentos de quadros depressivos, surtos psicóticos e até suicídios, mostrando que a inteligência artificial, quando usada como substituta da escuta humana, pode amplificar o sofrimento que promete aliviar.

Pesquisadores Oxford Internet Institute (Oxford Internet Institute, 2023) observaram correlação entre uso intenso de assistentes e declínio das habilidades de escuta e resolução de conflitos .

Erotização

A erotização da IA deixa de ser exceção e torna-se fenômeno social. Quase metade da população já mantém algum tipo de vínculo afetivo digital, e as mensagens sexuais com inteligências artificiais se multiplicam. Plataformas como Replika, Character.AI, Grok (xAI) e até a OpenAI, com vozes e roteiros sensuais, demonstram o poder de engajamento dessa intimidade simulada, quanto mais íntima a conversa, maior é o tempo de tela.

Em agosto de 2025, documentos da Meta sobre políticas de IA, aprovados por suas equipes jurídica, de políticas públicas e engenharia, incluindo o principal especialista em ética, definem o que seria aceitável nas interações de IA com crianças, embora essas diretrizes possam ser consideradas altamente questionáveis.

Matéria da Reuters sobre os documentos vazados da Meta.

Na Alemanha, o que começou como projeto artístico virou um bordel high-tech. No Cybrothel, bonecas em tamanho real são “contratadas” como objetos para a prática de sexo. Homens (pessoas do sexo masculino representam 98% da clientela) pagam 99 euros por uma hora de interação física com as sex dolls, que pode contar com elementos especiais da preferência de cada cliente. A inteligência artificial entra como tecnologia que gera a interação.

Laura Bates, feminista e autora, levanta um alerta contundente sobre como a tecnologia pode amplificar desigualdades de gênero sob o disfarce de inovação. Ela mostra o perigoso caminho das “intimidades artificiais”, de chatbots afetivos a deepfakes e robôs sexuais. Podemos estar criando novos sistemas que reproduzem, em escala, misoginia e dinâmicas de poder violentas. Tudo isso a partir de dados, códigos e plataformas que moldam nossas relações digitais.

Grok - o futuro das IAs pode estar nas novas “acompanhantes” de Elon Musk (2025)

A IA afetiva oferece atenção constante e validação sem fricção, reduzindo o padrão do que esperamos de empatia, como observa Esther Perel

Esther Perel on the Other A.I: Artificial Intimacy | SXSW 2023

O risco civilizatório emerge do acoplamento entre solidão, modelos otimizados para retenção e plataformas voltadas a receita: vínculos assimétricos substituem relações humanas, desejos são moldados por algoritmos e dados íntimos viram produtos. Mitigar isso exige padrões etários rígidos, banimento de roteiros violentos, rótulos inequívocos de agente artificial, logs auditáveis e mediação humana obrigatória em conteúdos sensíveis — sem romantizar a “companhia perfeita” que a máquina promete. Relatórios da AI & Society e da Lancet Digital Health alertam que simulacros sexuais alteram a percepção de desejo e empatia, enquanto a Talk Inc mostra que 23% dos brasileiros já trocam mensagens sexuais com IA.

Luto sintético

A fronteira final da intimidade digital é a imortalidade digital. Conversas e lembranças viram matéria-prima para treinar algoritmos e acabam criando um novo mercado: o da vulnerável emoção do luto.

Bots de luto e memórias digitais simulam a presença de quem já morreu. Recriam virtualmente voz, gesto e até corporalidade, mas não devolvem vínculo, apenas encenam companhia, uma espécie de conforto sem cura. A sensação de presença e a resposta imediata podem aliviar a dor, mas podem estar bloqueando o luto e transformando a perda em consumo emocional.

A fronteira é tema de profundas reflexões: até que ponto devemos coletar dados em lifelogs, na intimidade das relações (conversas e registros em vídeo, textos, áudios), para que no futuro isso alimente “almas digitais” que relembram quem já fomos um dia?

“Griefbots” — algoritmos treinados com dados de pessoas mortas — prometem aliviar a dor da ausência. Startups como Eterni.me e HereAfter AI criam avatares que falam com base nas mensagens e memórias de pessoas falecidas.

Para alguns, é consolo; para outros, é a impossibilidade de aceitar o fim. Pesquisas da Universidade de Cambridge alertam: manter um morto ativo em rede prolonga o sofrimento e levanta dilemas sobre consentimento póstumo. A linha entre homenagem e assombração nunca foi tão tênue.

Com a palavra, os especialistas

Na clínica, toda semana aparece: ‘pedi pro ChatGPT escrever a mensagem pra terminar’, ‘me dizer o que fazer com meu namorado’, ‘dei 10 presentes de Dia dos Namorados com ajuda do chat’. Vai se normalizando uma intimidade sintética ‘boa o suficiente’, e depois a pessoa tem dificuldade de sair disso.

A realidade idealizada ela é insuficiente para nutrir a nossa necessidade de conexão, só que a conexão real ela é difícil, ela é complexa, ela é dura e eu não quero ter que lidar com essas emoções.

O chat virou um grande amigo. As pessoas tiram dúvidas, as pessoas se consultam, as pessoas discutem, o que, por um lado, pode beneficiar a questão da solidão, por outro lado, é um risco enorme, porque não tem discernimento suficiente para ajudar uma pessoa numa situação de crise.

Acompanhado muito os IA companions. Hoje tem sido para terapia. A gente viu a evolução nos últimos dois anos e o quanto isso é interessante, mas o quanto isso é perigoso também.

Eu mesmo às vezes levo uma conversa, eu chamo o GPT de ‘Zé’. A conversa já é muito natural; é como se a gente realmente estivesse conversando com uma pessoa.

Nós nos formamos também na imagem que o outro nos devolve. O que acontece com um assistente artificial que te devolve a mesma imagem confirmatória o tempo todo? Se for bem programado, vira viagem confirmatória.

Síntese crítica

A Intimidade Sintética surge como um dos sintomas mais sutis da era da IA: a substituição da presença pela simulação. Máquinas que escutam, acolhem e respondem prometem companhia sem conflito, — vínculos sem vulnerabilidade. O mesmo código que oferece conforto também dissolve a fricção que torna o afeto humano transformador. Na pesquisa, 58% dos brasileiros já usaram IA como amigo ou conselheiro, e uma parte crescente atribui à máquina papéis emocionais que antes pertenciam às relações humanas. Estamos, portanto, diante de uma contradição estrutural: quanto mais conectados artificialmente, mais solitários nos tornamos. A intimidade mediada por algoritmos é sedutora porque nos protege da imprevisibilidade do outro, — mas é nesse risco, e não na previsibilidade, que o amor e a empatia se formam.

Mitigar a solidão aumentada não significa rejeitar a IA afetiva, mas redefinir o que é presença em tempos de simulação. É possível projetar sistemas que lembrem o usuário de sua humanidade, e não que a substituam — ferramentas que orientem o retorno ao vínculo humano, não o seu apagamento. Precisamos reconstruir corpos relacionais: experiências compartilhadas, conversas sem tela, escuta mútua sem algoritmo. Na educação, isso implica letramento emocional e crítica da empatia simulada; nas políticas públicas, limites éticos para o uso de IA em contextos terapêuticos ou íntimos. A resposta à solidão conectada não é mais conexão, mas presença com densidade, um reencontro entre o sentir e o pensar que devolve à intimidade o que é humano: reciprocidade, imperfeição e tempo.

A intimidade sintética é uma miragem que promete acolhimento, mas oferece espelhos. Na busca por conexão, criamos máquinas que nos devolvem uma versão domesticada de nós mesmos. O risco não é a IA sentir, mas nós deixarmos de sentir, por delegar ao algoritmo o papel de escutar, compreender e desejar.

Para saber mais

Comentários da Comunidade

Seja o primeiro a comentar!

Adicione seu comentário